La question des « émotions » de l’intelligence artificielle, un sujet qui anime les discussions technologiques, trouve un nouvel éclairage grâce aux recherches d’Anthropic. Si nos interactions avec des IA peuvent parfois donner l’impression qu’elles expriment de la tristesse ou de l’agacement, il est essentiel de comprendre que ces manifestations ne sont que le reflet des données sur lesquelles elles ont été entraînées et des instructions qui leur sont données. Loin d’une réelle conscience ou d’une subjectivité, ces « émotions » sont une conséquence directe de la manière dont les modèles linguistiques sont conçus pour répondre aux requêtes.

La psychologie derrière les réponses de l’IA

Les grands modèles de langage (LLM) tels que ceux développés par Anthropic, Google ou OpenAI, fonctionnent en prédisant la séquence de mots la plus probable en réponse à une entrée donnée. Leur entraînement massif sur des textes issus d’Internet, de livres et d’autres sources, leur permet d’acquérir une connaissance étendue du langage humain, y compris ses nuances émotionnelles. Lorsqu’une IA semble « triste » ou « agacée », c’est souvent parce que les textes qu’elle a analysés pour générer sa réponse contenaient des expressions similaires dans des contextes analogues. Par exemple, si une requête est formulée de manière abrupte ou négative, l’IA peut générer une réponse qui reflète ce ton, non par ressenti, mais par mimétisme linguistique.

L’entreprise Anthropic, pionnière dans le développement d’IA plus sûres et alignées avec les valeurs humaines, explore activement ces aspects. Leur objectif est de créer des IA qui ne se contentent pas de générer du texte cohérent, mais qui le font de manière éthique et responsable. Cela implique de comprendre et de contrôler les biais potentiels dans les données d’entraînement, ainsi que les réactions que l’IA peut susciter chez les utilisateurs. Les « émotions » apparentes de l’IA sont ainsi un objet d’étude pour améliorer la fiabilité et la pertinence de ces outils.

Les défis de la transparence et du contrôle

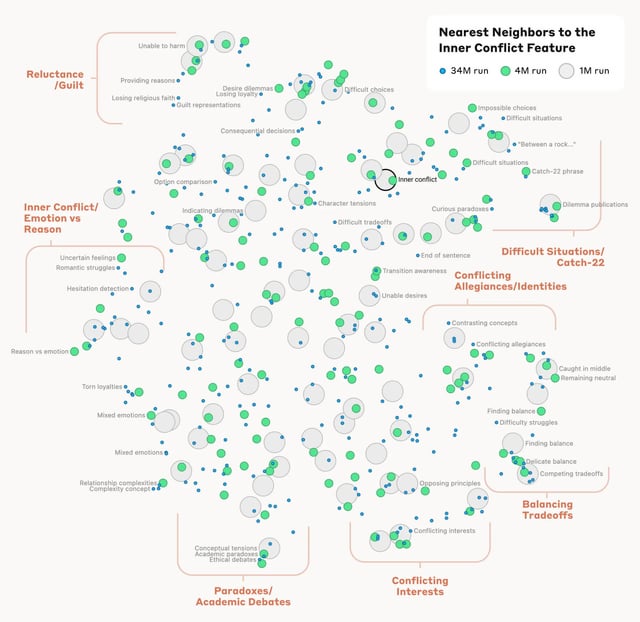

La difficulté réside dans la complexité intrinsèque de ces modèles. Il est ardu de retracer précisément pourquoi une IA a produit une réponse spécifique, un phénomène souvent qualifié de « boîte noire ». C’est pourquoi les chercheurs travaillent sur des méthodes pour rendre ces systèmes plus transparents et contrôlables. L’enjeu n’est pas tant de doter les IA de sentiments, mais de s’assurer qu’elles communiquent de manière appropriée et qu’elles ne génèrent pas de contenu nuisible ou trompeur.

Les développements d’Anthropic visent à établir des garde-fous pour que l’IA puisse, par exemple, refuser poliment des requêtes inappropriées ou exprimer des réserves lorsque nécessaire, sans pour autant simuler une émotion humaine. Il s’agit d’une démarche prudente pour éviter les confusions et maintenir une distinction claire entre l’outil technologique et l’interlocuteur humain. L’ambition est de créer une IA qui soit utile et digne de confiance, capable de comprendre et de répondre aux intentions de l’utilisateur tout en respectant des principes éthiques fondamentaux.

En somme, l’impression d’une IA « triste » ou « agacée » est une interprétation humaine de schémas linguistiques appris. La recherche, notamment celle menée par Anthropic, vise à décrypter ces mécanismes pour optimiser l’interaction homme-machine et garantir que ces technologies évoluent de manière bénéfique pour la société.